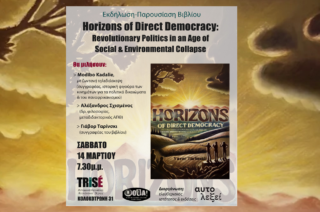

του Αλέξανδρου Σχισμένου

Εισαγωγή

Στις 14 Ιανουαρίου 2026, το Παγκόσμιο Οικονομικό Φόρουμ εξέδωσε την Έκθεση για τους Παγκόσμιους Κινδύνους [Global Risks Report], μια ολοκληρωμένη επίσημη ανάλυση των πιθανών κινδύνων που αντιμετωπίζει ο πλανήτης το 2026. Αυτό έγγραφο συντάχθηκε αποκλειστικά από το Παγκόσμιο Οικονομικό Φόρουμ πριν από την Ετήσια Συνάντηση του 2026, που πραγματοποιήθηκε με θέμα «Το πνεύμα του διαλόγου» από τις 19 έως τις 23 Ιανουαρίου στο Νταβός της Ελβετίας. Σύμφωνα με τους συντάκτες του κειμένου:

«Η Έκθεση Παγκόσμιων Κινδύνων 2026, η 21η έκδοση αυτής της ετήσιας έκθεσης, σηματοδοτεί το δεύτερο μισό μιας ταραχώδους δεκαετίας. Η έκθεση αναλύει τους παγκόσμιους κινδύνους μέσα από τρία χρονικά πλαίσια, με σκοπό να υποστηρίξει τους υπεύθυνους λήψης αποφάσεων στην εξισορρόπηση των τρεχουσών κρίσεων και των μακροπρόθεσμων προτεραιοτήτων».

Μεταξύ των πολυάριθμων πιθανών κινδύνων που ελλοχεύουν στο μέλλον, το έγγραφο δίνει ιδιαίτερη έμφαση στην επέκταση της Τεχνητής Νοημοσύνης, και για καλούς λόγους.

Στις επόμενες παραγράφους, θα σχολιάσω τα ευρήματα της GRR 2026, τα οποία θεωρώ ενδείξεις της ανόδου της ψηφιακής βαρβαρότητας, την οποία εννοώ, στο πλαίσιο της έρευνάς μου για τον Ψηφιακό Λόγο, ως τη συστημική διάβρωση των κοινωνικών σημασιών που προκαλείται από την κυριαρχία της αλγοριθμικής λογικής. Εκδηλώνεται όταν τα υπολογιστικά συστήματα αναδιοργανώνουν τις συνθήκες υπό τις οποίες τα άτομα και οι συλλογικότητες ερμηνεύουν, ενεργούν και φαντάζονται.

Για να συνοψίσω το επιχείρημα του πρόσφατου βιβλίου μου «Τεχνολογία και βαρβαρότητα: Κριτική της τεχνητής νοημοσύνης”, η τεχνητή νοημοσύνη πρέπει να γίνει κατανοητή όχι ως αυτόνομος παράγοντας, αλλά ως έκφραση των κυρίαρχων φαντασιακών σημασιών της σύγχρονης κοινωνίας. Η ψηφιακή επανάσταση δεν είναι απλώς τεχνική· είναι μια οντολογική επανάσταση που αναδιαμορφώνει το νόημα, την υποκειμενικότητα και τον κοινωνικό χρόνο. Αυτό όμως έχει φτάσει σε νέα ύψη μετά τον ταχέως ψηφιακό μετασχηματισμό κατά τη διάρκεια της πανδημίας, την δημόσια κυκλοφορία του ChatGPT τον Νοέμβριο του 2022 και την ταχεία και εκτεταμένη διάδοση των εφαρμογών τεχνητής νοημοσύνης σε όλους τους τομείς της κοινωνικής ζωής.

Η GRR 2026 του Παγκόσμιου Οικονομικού Φόρουμ αναγνωρίζει ότι:

«Η τεχνητή νοημοσύνη έχει μετατραπεί από μια πρωτοποριακή τεχνολογία σε μια συστημική δύναμη που διαμορφώνει τις οικονομίες, τις κοινωνίες και την ασφάλεια. Το μέγεθος της παγκόσμιας αγοράς για την τεχνητή νοημοσύνη προβλέπεται να αυξηθεί από περίπου 280 δισεκατομμύρια δολάρια το 2024 σε 3,5 τρισεκατομμύρια δολάρια έως το 2033.» – GRR2026.

Φαίνεται ότι έχουμε εισέλθει σε μια νέα φάση της ψηφιακής οντολογικής επανάστασης, που κάποιοι αποκαλούν Web 4.0, «έξυπνο» ή «συμβιωτικό» διαδίκτυο, όπου η τεχνητή νοημοσύνη εμφανίζεται ως παράγοντας που μιμείται και αναπαράγει την ανθρώπινη επικοινωνία. Τα συστήματα τεχνητής νοημοσύνης έχουν διεισδύσει στην επικοινωνία, την εργασία, την εκπαίδευση και τη διακυβέρνηση, ενώ ο δημόσιος διάλογος έχει πολωθεί σε τεχνοφιλικά οράματα προόδου και τεχνοφοβικούς φόβους κατάρρευσης.

Και οι δύο τάσεις βασίζονται σε υπερβολικές αφηγήσεις που συσκοτίζουν τις βαθύτερες κοινωνικο-ιστορικές δυναμικές. Προέρχονται από το φαντασιακό της εργαλειακής λογικής, με κριτήρια την αποδοτικότητα, τη βελτιστοποίηση και την ποσοτικοποίηση. Είναι το καπιταλιστικό κοινωνικό φαντασιακό που πηγάζει από την καρτεσιανή επιταγή να «γίνουμε οι άρχοντες και οι ιδιοκτήτες της φύσης» [Descartes 1635].

Η άκριτη τεχνοφιλία είναι μια βασική φανταστική σημασία της καπιταλιστικής νεωτερικότητας και, ως τέτοια, υιοθετήθηκε από μερικούς από τους πιο κριτικούς αντιπάλους του βιομηχανικού καπιταλισμού, όπως ο Saint-Simon, ο Fourier και, κυρίως, ο Karl Marx. Ο Καστοριάδης έχει επισημάνει ότι ένα από τα συντηρητικά στοιχεία της μαρξιστικής σκέψης είναι η αποδοχή της τεχνολογίας ως δύναμης προόδου και η τάση να περιστέλλεται η παραγωγή, η ανθρώπινη δραστηριότητα που διαμεσολαβείται από όργανα και αντικείμενα, η εργασία, σε «παραγωγικές δυνάμεις», δηλαδή στην τεχνική. [Η Φαντασιακή Θέσμιση της Κοινωνίας].

Η ψηφιακή επανάσταση είναι, επομένως, μια μεταμόρφωση του συμβολικού πεδίου μέσω του οποίου οι κοινωνίες ερμηνεύουν τον εαυτό τους. Η τεχνητή νοημοσύνη γίνεται η προνομιακή έκφραση αυτού του φαντασιακού: ένας μηχανισμός πρόβλεψης, ελέγχου και αυτοματοποίησης, ως αιχμή του δόρατος της καπιταλιστικής προσπάθειας για την πλήρη κυριαρχία της φύσης, τόσο της άψυχης όσο και της ανθρώπινης, μέσω της ψηφιοποίησης. Η ψηφιακή βαρβαρότητα δεν μπορεί να γίνει κατανοητή χωρίς αναφορά σε αυτές τις φαντασιακές σημασίες.

Ο ορίζοντας της ψηφιακής βαρβαρότητας δεν είναι το χάος, αλλά η υποταγή της κοινωνικής ζωής στην αλγοριθμική διακυβέρνηση βασισμένη σε αυτοματοποιημένες παραμέτρους ελεγχόμενες από απρόσιτους μηχανισμού εξουσίας.

Η άνοδος της μυθοπληροφορίας

Η GRR 2026 είναι ένα επίσημο έγγραφο που υπογραμμίζει τους κινδύνους της ψηφιακής βαρβαρότητας και δικαιολογεί τις υποψίες μας, ξεκινώντας από την Εισαγωγή:

«Η παραπληροφόρηση, η αποπληροφόρηση και η ανασφάλεια στον κυβερνοχώρο κατατάχθηκαν στην 2η και 6η θέση των μεγαλύτερων κινδύνων, αντίστοιχα, στην προοπτική των δύο ετών. Τα αρνητικά αποτελέσματα της τεχνητής νοημοσύνης είναι ο κίνδυνος με τη μεγαλύτερη άνοδο στην κατάταξη με την πάροδο του χρόνου, μετακινούμενος από την 30η θέση στην προοπτική των δύο ετών στην 5η θέση στην προοπτική των 10 ετών.» – GRR 2026

Η παραπληροφόρηση και η αποπληροφόρηση στον κυβερνοχώρο είναι το αποτέλεσμα αυτού που ο Langdon Winner ονόμασε «μυθοπληροφορία» [mythinformation], δηλαδή «η σχεδόν θρησκευτική πεποίθηση ότι η ευρεία υιοθέτηση υπολογιστών και συστημάτων επικοινωνίας και η ευρεία πρόσβαση σε ηλεκτρονικές πληροφορίες θα δημιουργήσουν αυτόματα έναν καλύτερο κόσμο για την ανθρωπότητα». (Winner 1984.)

Η πιο άμεση και προφανής επίδραση της μυθοπληροφόρησης είναι οικονομική και συνδέεται άμεσα με την αύξηση των χρηματοοικονομικών επενδύσεων σε εταιρείες τεχνητής νοημοσύνης.

Οι σύγχρονες ψηφιακές αγορές αντιπροσωπεύουν αυτό που η Shoshana Zuboff αποκαλεί «καπιταλισμό της επιτήρησης» – μια νέα οικονομική τάξη που θεωρεί την ανθρώπινη εμπειρία ως «ελεύθερη πρώτη ύλη» για εμπορικές πρακτικές εκμετάλλευσης και τροποποίησης της συμπεριφοράς. Αυτό αντιπροσωπεύει ένα «άνωθεν πραξικόπημα» και μια «ψηφιακή στέρηση» της ελευθερίας.

Αντλώντας από τις «μυθοπλασίες των εμπορευμάτων» του Karl Polanyi (η εργασία ως ζωή, η φύση ως ακίνητη περιουσία, το χρήμα ως μέσο ανταλλαγής), μπορούμε να εντοπίσουμε μια τέταρτη μυθοπλασία: τη μετατροπή της προσωπικής εμπειρίας και της ατομικής συμπεριφοράς σε αξίες της αγοράς. Μέσω των «αλγορίθμων εξατομίκευσης», οι ιδιωτικές εταιρείες αντικειμενοποιούν την προσωπική εμπειρία, περιστέλλοντας τα άτομα σε μετρήσιμα πρότυπα συμπεριφοράς με σκοπό την προσέλκυση της προσοχής και την κατανάλωση χρόνου.

Η τεχνητή νοημοσύνη συμβάλλει σε αυτό που ο Luciano Floridi αποκαλεί περιτύλιξης («enveloping»). Αντί να κατασκευάζονται μηχανές προσαρμοσμένες στον ανθρώπινο κόσμο, οι κοινωνικές σχέσεις μετασχηματίζονται για να προσαρμοστούν στις ψηφιακές τεχνολογίες και τις εφαρμογές τεχνητής νοημοσύνης. Μα η επέκταση της τεχνητής νοημοσύνης δεν ωθείται από τεχνολογικά επιτεύγματα αλλά από την πολιτική βούληση συγκεκριμένων μηχανισμών.

Το 2025, οι χρηματιστηριακές αγορές επηρεάστηκαν από πολιτικές αποφάσεις σχετικά με τη χρηματοδότηση εταιρειών τεχνητής νοημοσύνης σε όλο τον κόσμο.

Την πρώτη εβδομάδα της προεδρίας του, μετά την ορκωμοσία του στις 20 Ιανουαρίου 2025, ο Ντόναλντ Τραμπ ανακοίνωσε ένα πακέτο 500 δισεκατομμυρίων δολαρίων για την ανάπτυξη της ψηφιακής τεχνολογίας.

Μια εβδομάδα αργότερα, δύο κινεζικές εταιρείες [DeepSeek και ByteDance, ιδιοκτήτρια της TikTok] παρουσίασαν μοντέλα TN [LLM] που λειτουργούν με 50 φορές χαμηλότερο κόστος εκπαίδευσης.

Στις 18 Φεβρουαρίου 2025, ο Elon Musk παρουσίασε το τελευταίο μοντέλο Γενετικής Τεχνητής Νοημοσύνης από την εταιρεία του xAI, το Grok 3, το οποίο περιλαμβάνει ένα chatbot, δύο μοντέλα συλλογιστικής και έναν ψηφιακό βοηθό έρευνας, ισχυριζόμενος ψευδώς ότι μιμείται την «ανθρώπινη νοημοσύνη». Τροφοδοτείται από τον υπερυπολογιστή xAI Colossus, με 200.000 μονάδες επεξεργασίας γραφικών [GPUs], και έχει προ-εκπαιδευτεί για 1.000.000 ώρες GPU. Βρίσκεται στο Μέμφις και το σύστημα καταναλώνει 18.927.058 λίτρα νερού την ημέρα για ψύξη. Κατασκευάστηκε σε λιγότερο από οκτώ μήνες και περιλαμβάνει μεγάλες ενεργειακές εγκαταστάσεις για το ψηφιακό σύστημα που καταναλώνει μεγάλη ποσότητα ενέργειας.

Κατά τη διάρκεια του καλοκαιριού, ο Πρόεδρος Τραμπ αποφάσισε ότι οι εταιρείες τεχνητής νοημοσύνης θα μπορούσαν να χρηματοδοτούν τις δικές τους ενεργειακές εγκαταστάσεις χρησιμοποιώντας ομοσπονδιακούς πόρους. Με προεδρικό διάταγμα στις 12 Δεκεμβρίου 2025, ο Τραμπ ανέστειλε το δικαίωμα των Πολιτειών να θεσπίζουν ρυθμιστικούς νόμους και περιορισμούς για τις εταιρείες τεχνητής νοημοσύνης.

Μεταξύ άλλων, τα παραπάνω πολιτικά – και όχι επιστημονικά – γεγονότα συνέβαλαν στην εκτίναξη των επενδύσεων σε εταιρείες τεχνητής νοημοσύνης:

«Οι συνολικές δαπάνες για την τεχνητή νοημοσύνη παγκοσμίως εκτιμάται ότι θα ανέλθουν σε 1,5 τρισεκατομμύρια δολάρια το 2025 και προβλέπεται να αυξηθούν σε 2 τρισεκατομμύρια δολάρια το 2026, με κύρια τμήματα να είναι τα smartphone γενετικής τεχνητής νοημοσύνης (genAI), οι διακομιστές βελτιστοποιημένοι για τεχνητή νοημοσύνη, υπηρεσίες τεχνητής νοημοσύνης, λογισμικό εφαρμογών τεχνητής νοημοσύνης, ημιαγωγοί επεξεργασίας τεχνητής νοημοσύνης και λογισμικό υποδομής τεχνητής νοημοσύνης.68 Μόνο οι κεφαλαιουχικές δαπάνες των οκτώ κορυφαίων υπερμεγέθων παρόχων υπηρεσιών cloud (hyperscalers) των ΗΠΑ ανήλθαν σε 258 δισεκατομμύρια δολάρια το 2024 και προβλέπεται να υπερδιπλασιαστούν σε 525 δισεκατομμύρια δολάρια το 2032.» – GRR2026: 44

Ωστόσο, οι υποσχέσεις για την Γενική Τεχνητή Νοημοσύνη [AGI] δεν υλοποιήθηκαν και άρχισαν να εκδηλώνονται φόβοι για μια πιθανή οικονομική φούσκα.

Όπως επισημαίνει η GRR2026, αυτή η αύξηση των κεφαλαιουχικών επενδύσεων ενέχει σημαντικό κίνδυνο:

«Υπάρχει επί του παρόντος ευρεία ανησυχία σχετικά με τις αυξημένες τιμές των μετοχών των μεγαλύτερων εταιρειών τεχνολογίας, και το 2025 παρατηρήθηκαν περιόδους έντονου ενδιαφέροντος των επενδυτών όχι μόνο για μετοχές που σχετίζονται με την τεχνητή νοημοσύνη (AI), αλλά και για τομείς όπως η πυρηνική ενέργεια, η κβαντική ενέργεια ή οι σπάνιες γαίες. Η απότομη άνοδος των τιμών των πολύτιμων μετάλλων έχει προκαλέσει ανησυχίες για φούσκα και σε αυτόν τον τομέα. Ορισμένες από αυτές τις τιμές έχουν σταθεροποιηθεί ή διορθωθεί έκτοτε, αλλά οι ανησυχίες για την υπερτίμηση των αγορών παραμένουν. Εάν οι προβλέψεις για το σκάσιμο της φούσκας των περιουσιακών στοιχείων αποδειχθούν αληθινές, οι πιθανές επιπτώσεις μπορεί να είναι σημαντικές. Οι παγκόσμιοι θεσμικοί και ιδιώτες επενδυτές έχουν επενδύσει σε μεγάλο βαθμό στις αμερικανικές χρηματιστηριακές αγορές σε σχέση με τα ιστορικά πρότυπα, οπότε οι πιθανές επιπτώσεις ενός κραχ θα μπορούσαν να είναι σοβαρές για την παγκόσμια οικονομία. Το 85% των επικεφαλής οικονομολόγων παγκοσμίως τον Σεπτέμβριο του 2025 πιστεύουν ότι ένα χρηματοπιστωτικό σοκ θα είχε ευρείες συστημικές επιπτώσεις.» – GRR2026

Το Παγκόσμιο Οικονομικό Φόρουμ επιβεβαιώνει την εικόνα ενός φαύλου οικονομικού κύκλου, όπως τον περιέγραψε ο Δρ. Άλεξ Παζαΐτης σε μια διαδικτυακή συζήτηση: τα έσοδα των εταιρειών που αναπτύσσουν μοντέλα τεχνητής νοημοσύνης για την αγορά είναι πενιχρά σε σύγκριση με τις συνεχώς αυξανόμενες δεσμεύσεις τους για δαπάνες και επενδύσεις σε περισσότερη υπολογιστική ισχύ. Έτσι, η χρηματοδότησή τους συνεχίζεται με χρήματα που λαμβάνουν από «επενδύσεις» εταιρειών όπως η NVidia, από την οποία στη συνέχεια αγοράζουν επεξεργαστές. Η NVidia «επενδύει» ταυτόχρονα κεφάλαια σε εταιρείες που παρέχουν υποδομή υπολογιστικού νέφους, όπως η Oracle, η οποία στη συνέχεια αγοράζει επεξεργαστές από την NVidia για να προσφέρει υπηρεσίες σε εταιρείες όπως η OpenAI για τη φιλοξενία των δεδομένων των μοντέλων τους. Και ο κύκλος των αυτοαναφορικών επενδύσεων συνεχίζεται ασταμάτητα.

Μπορούμε να το ονομάσουμε οικονομικό φαύλο κύκλο αυτοαναφορικών επενδύσεων.

Αυτός ο φαύλος κύκλος αυτοαναφορικών επενδύσεων μπορεί να συνεχιστεί για κάποιο διάστημα, έως ότου σκάσει η φούσκα λόγω της συσσώρευσης πολιτικού κεφαλαίου από εταιρείες τεχνητής νοημοσύνης που ανήκουν σε επιρροή πολιτικούς παράγοντες όπως ο Elon Musk. Αυτό μόνο διευρύνει τον φαύλο κύκλο ώστε να περιλαμβάνει και άλλους τομείς της επικοινωνίας, των διαστημικών ταξιδιών και των μεταφορών και διευρύνει την περιοχή επιρροής της ψηφιακής μυθοπληροφόρησης.

Και η τάση μεγέθυνσης συνεχίζεται το 2026. Τον Φεβρουάριο, ο Elon Musk συγχώνευσε το X [Twitter] με την xAI [Grok] ώστε η ΤΝ να έχει άμεση πρόσβαση σε όλα τα δεδομένα των χρηστών και έπειτα συγχώνευσε την xAI με την SpaceX, υποσχόμενος data centers στη Σελήνη και Τεχνητή Νοημοσύνη στο διάστημα. Εκατοντάδες εργαζόμενοι παραιτήθηκΝ από την xAI γιατί καταργήθηκε το τμήμα ασφάλειας της ΤΝ και κάθε προληπτικός περιορισμός.

Η συγκέντρωση πολιτικού και οικονομικού κεφαλαίου, υπολογιστικής ισχύος, δεδομένων χρηστών και ψηφιακής τεχνολογίας σε μια χούφτα εταιρειών δημιουργεί μια απότομη ιεραρχική πυραμίδα πληροφοριακής ισχύος που διευρύνει το χάσμα της ανισότητας τόσο σε κοινωνική όσο και σε διεθνή κλίμακα. Η GRR2026 επισημαίνει την άνιση κατανομή της ισχύος όσον αφορά την τεχνητή νοημοσύνη:

«Η πρόσβαση σε υποδομές τεχνητής νοημοσύνης, καθώς και σε ηλεκτρική ενέργεια, πρόσβαση στο διαδίκτυο και αποθήκευση δεδομένων, θα ενισχύσει τις μεταβολές στην οικονομική ισχύ μεταξύ των χωρών κατά την επόμενη δεκαετία, καθώς τα οφέλη της τεχνητής νοημοσύνης σε επίπεδο παραγωγικότητας θα παρακάμψουν εντελώς ορισμένους πληθυσμούς, αν και θα τους προστατεύσουν από ορισμένους κινδύνους. Για παράδειγμα, η υιοθέτηση της τεχνητής νοημοσύνης στη Βόρεια Αμερική (27% του πληθυσμού σε ηλικία εργασίας) είναι τριπλάσια από εκείνη στην υποσαχάρια Αφρική (9%).

Μόνο λίγα κέντρα δεδομένων τεχνητής νοημοσύνης βρίσκονται σε αναπτυσσόμενες περιοχές, με τις Ηνωμένες Πολιτείες, την Ευρώπη και την Ανατολική Ασία να κυριαρχούν σε όρους χωρητικότητας. Εντός των χωρών, το χάσμα μεταξύ των γεωγραφικών περιοχών που έχουν ενσωματώσει την τεχνητή νοημοσύνη και των περιφερειών που έχουν αποκλειστεί μπορεί επίσης να οδηγήσει σε τοπικές μεταβολές της ισχύος, να δημιουργήσει εσωτερικές μεταναστευτικές πιέσεις και να αποσταθεροποιήσει την εθνική συνοχή.» – GRR2026

Αυτό σηματοδοτεί μια σημαντική διεύρυνση του μετα-αποικιακού χάσματος εξουσίας μεταξύ των δυτικών/ανατολικών τεχνοκαπιταλιστικών χωρών και των φτωχών χωρών του παγκόσμιου Νότου. Αλλά σηματοδοτεί επίσης μια διεύρυνση του εσωτερικού χάσματος ισότητας μεταξύ των κυβερνώντων ελίτ και των εργατικών τάξεων εντός κάθε χώρας.

Η GRR2026 αφιερώνει ένα ολόκληρο κεφάλαιο [2.7] στη συζήτηση τριών ομάδων κινδύνων που συνδέονται με τις εφαρμογές της τεχνητής νοημοσύνης:

«Πρώτον, οι ευρέως αναφερόμενες ανησυχίες σχετικά με τον αντίκτυπο στις αγορές εργασίας θα μπορούσαν να οδηγήσουν σε βαθύτερη κοινωνική πόλωση, εάν αυξηθεί η ανεργία και οι εργαζόμενοι δυσκολευτούν να προσαρμοστούν σε νέα καθήκοντα και ρόλους. Σε ένα τέτοιο σενάριο, θα μπορούσαν να εκδηλωθούν ταυτόχρονα τόσο υψηλότερη παραγωγικότητα όσο και υψηλότερη ανεργία».

Σημειώστε αυτή τη φράση: υψηλότερη παραγωγικότητα με υψηλότερη ανεργία. Αυτό είναι άμεση συνέπεια της επέκτασης της αυτοματοποίησης σε όλες τις κοινωνικές λειτουργίες που μπορούν να αναχθούν σε αλγοριθμικές λειτουργίες. Φαίνεται επίσης να συνάδει με την κεντρική φαντασιακή σημασία του νεοφιλελεύθερου δόγματος του καπιταλισμού, που δίνει έμφαση στο κέρδος έναντι της παραγωγής, ενώ ταυτόχρονα αποτελεί την υλοποίηση της φαντασιακής σημασίας της τεχνοκρατίας, της μείωσης του ανθρώπινου παράγοντα στην παραγωγή.

Φυσικά, τα αποτελέσματα είναι κοινωνική αναταραχή, μαζική ανεργία, μαζική φτώχεια, η ξαφνική υποτίμηση της σημασίας της εργασίας και η ρήξη των κοινωνικών δεσμών.

Μπορούμε να το ονομάσουμε πολιτικό φαύλο κύκλο συστημικής ανισότητας σε εθνικό και διεθνές επίπεδο.

Παρόλα αυτά, θα πρέπει να διευρύνουμε τον ορισμό της συστημικής ανισότητας ώστε να συμπεριλάβει την οικολογική καταστροφή, η οποία μπορεί να επηρεάσει όλους, αλλά δεν έχουν όλοι τα μέσα να μετριάσουν την καταστροφή στη δημόσια υγεία και τις συνθήκες διαβίωσης. Η GRR2026 επισημαίνει τους περιβαλλοντικούς κινδύνους της τεχνητής νοημοσύνης:

«Υπάρχουν επίσης δευτερογενείς φυσιολογικές επιπτώσεις στην υγεία, που προέρχονται από τις περιβαλλοντικές επιπτώσεις των γενετικών μοντέλων τεχνητής νοημοσύνης. Αυτά μπορούν να καταναλώνουν έως και 4.600 φορές περισσότερη ενέργεια από το παραδοσιακό λογισμικό. Οι υποδομές που σχετίζονται με την τεχνητή νοημοσύνη μπορούν να οδηγήσουν σε υποβάθμιση της ποιότητας του αέρα και ρύπανση από την κατασκευή, την παραγωγή ηλεκτρικής ενέργειας και τη διάθεση ηλεκτρονικών αποβλήτων. Μόνο στις Ηνωμένες Πολιτείες, αυτό θα μπορούσε να επιβαρύνει τη δημόσια υγεία με πάνω από 20 δισεκατομμύρια δολάρια ετησίως έως το 2028» – GRR2026: 54

Τέτοιες είναι οι επιπτώσεις της κατεστημένης παραπληροφόρησης γύρω από τις εμπορευματοποιημένες μελλοντικές προβλέψεις της τεχνητής νοημοσύνης στους εξωτερικούς κοινωνικούς τομείς της οικονομίας, της οικολογίας και της πολιτικής. Ωστόσο, αυτές οι επιπτώσεις αντανακλώνται και διπλασιάζονται στους εσωτερικούς ιδιωτικούς τομείς της διαπροσωπικής επικοινωνίας και της αντίληψης της πραγματικότητας.

Οι κίνδυνοι της μυθοπληροφόρησης είναι ακόμη μεγαλύτεροι στον κυβερνοχώρο από ό,τι στις χρηματιστηριακές αγορές. Ο κυβερνοχώρος, ως μια νέα σφαίρα ύπαρξης, αντιπροσωπεύει μια μορφή ετερότητας (διαφορετικότητας) όπου το υποκειμενικό και το αντικειμενικό συγχωνεύονται σε μια εικονική υποκειμενική αντικειμενικότητα. Αυτό υποδηλώνει ότι το Διαδίκτυο δεν μεσολαβεί απλώς στις υπάρχουσες επικοινωνίες μας, αλλά δημιουργεί ένα ενδιάμεσο ψηφιακό στρώμα με μοναδικά επιστημολογικά χαρακτηριστικά και δυνατότητες, όπου η τηλεπαρουσία προϋποθέτει φυσική απουσία και η επικοινωνία περιορίζεται στη σύνταξη. Αυτά υπογραμμίζουν τους γνωσιακούς κινδύνους της τεχνητής νοημοσύνης.

«Δεύτερον, καθώς όλο και περισσότερες εργασίες αναλαμβάνονται από την τεχνητή νοημοσύνη και οι δεξιότητες που προηγουμένως εφαρμόζονταν από τον άνθρωπο αρχίζουν να ατροφούν, δεν είναι σαφές αν η πορεία προς τα εμπρός θα είναι μια χρυσή εποχή για τη δημιουργικότητα, τον ελεύθερο χρόνο και τη μάθηση – ή, αντίθετα, μια ώθηση προς την απουσία σκοπού, την απάθεια και την κοινωνική παρακμή». – GRR2026

Τα μεγάλα γλωσσικά μοντέλα εισάγουν μια νέα γνωστική αστάθεια. Τα αποτελέσματά τους είναι εύλογα αλλά αναξιόπιστα, συχνά υπερβάλλοντας ή παραμορφώνοντας τα συμπεράσματα. Καθώς διεισδύουν στην εκπαίδευση, την έρευνα και την πολιτική, απειλούν να αυτοματοποιήσουν τα γνωστικά λάθη σε μεγάλη κλίμακα.

Στην εποχή της τεχνητής νοημοσύνης, η παραπληροφόρηση εξαπλώνεται ραγδαία μέσω πλατφορμών που έχουν βελτιστοποιηθεί για να προσελκύουν την προσοχή, εκτοπίζοντας τον λογικό διάλογο και διαβρώνοντας το δημόσιο πεδίο επικοινωνίας σε παγκόσμια κλίμακα μέσω των ψηφιακών κοινωνικών μέσων. Η αυξανόμενη εξάρτηση από εφαρμογές τεχνητής νοημοσύνης για την παραγωγή κοινής γνώσης έχει αρχίσει να απειλεί την κοινή δημόσια αντίληψη για την πραγματικότητα.

«Η αυξανόμενη εξάρτηση τόσο από τα μέσα κοινωνικής δικτύωσης όσο και από τα εργαλεία τεχνητής νοημοσύνης ενισχύει τον αντίκτυπο της αλγοριθμικής μεροληψίας, η οποία διαμορφώνει τις πληροφορίες που βλέπουν οι χρήστες στο διαδίκτυο και ενισχύει την έκθεση των ατόμων σε πληροφορίες που συνάδουν με τις απόψεις τους. Αυτό μπορεί να δημιουργήσει ευρέως αποκλίνουσες απόψεις σχετικά με τα πραγματικά γεγονότα και τις εξελίξεις. Οι επιπτώσεις αρχίζουν να γίνονται ακόμη πιο βαθιές. Ο τρόπος με τον οποίο ερμηνεύονται τα γεγονότα του πραγματικού κόσμου στο διαδίκτυο, σε συνδυασμό με την αυξανόμενη κυκλοφορία βίαιου περιεχομένου στα μέσα κοινωνικής δικτύωσης, μπορεί να οδηγεί τους πολίτες να γίνονται πιο συναισθηματικά και γνωστικά αποστασιοποιημένοι και αδιάφοροι απέναντι στις ανθρώπινες τραγωδίες». – GRR2026

Πρέπει να τονίσουμε ότι, δεδομένης της εξάρτησης του παγκόσμιου κοινού από τις ψευδείς πληροφορίες, η κοινή λογική γύρω από την πραγματικότητα μπορεί εύκολα να χειραγωγηθεί μέσω της προπαγάνδας, ακόμη και πριν από την τεχνητή νοημοσύνη. Ωστόσο, πρέπει να παρατηρήσουμε ότι η διείσδυση του ψηφιακού πεδίου στο κοινωνικό φαντασιακό είναι τόσο βαθιά που οι εφαρμογές τεχνητής νοημοσύνης μετασχηματίζουν επίσης την αίσθηση της πραγματικότητας σε επιστημονικούς όρους.

Η παραπάνω ανησυχία είναι δικαιολογημένη, δεδομένου του τεράστιου όγκου επιστημονικών άρθρων και ενημερωτικού υλικού που παράγεται σήμερα από μοντέλα γενετικής τεχνητής νοημοσύνης. Αυτό συμβαίνει ήδη στους τομείς της παραγωγής ακαδημαϊκής γνώσης, όπως στην περίπτωση των ψηφιακών απολιθωμάτων [digital fossils]. Ένα ψηφιακό απολίθωμα είναι ένα παλιό σφάλμα που διατηρείται σε αρχεία που χρησιμοποιούνται ως δεδομένα εκπαίδευσης τεχνητής νοημοσύνης και αναπαράγεται αυτόματα και απροσδόκητα σε νέα αποτελέσματα.

Ωστόσο, τα ψηφιακά απολιθώματα είναι ένα ανεπιθύμητο υποπροϊόν των LLM. Πρέπει να τα θεωρούμε ως δείκτες μιας ευρύτερης επιστημολογικής διάβρωσης της δημόσιας γνώσης.

Αυτή η γνωστική διάβρωση είναι βαθύτερη από τον δημόσιο διάλογο, καθώς τα ψηφιακά μέσα και οι εφαρμογές τεχνητής νοημοσύνης στοχεύουν στην προσωποποίηση και την ιδιωτική αλληλεπίδραση από τη σχεδίασή τους. Ο κυβερνοχώρος δίνει την ψευδή εντύπωση ενός ψηφιακού δημόσιου χώρου, ενώ στην πραγματικότητα είναι περισσότερο ένα δίκτυο αλληλοσυνδεόμενων εικονικών ιδιωτικών χώρων. Κάθε χρήστης επικοινωνεί με τη μορφή τηλεπαρουσίας μέσω ψηφιακών προσωπικοτήτων, από τον δικό του ιδιωτικό χρόνο και χώρο, ακόμα και όταν βρίσκεται σε δημόσιο χώρο. Αν προσθέσετε chatbots τεχνητής νοημοσύνης στην άλλη πλευρά της τηλεπικοινωνίας, κάθε χρήστης μπορεί να παγιδευτεί σε ένα δίχτυ αυτοαναφορικού ψευδοδιαλόγου. Σε αυτό το σημείο, τα παραδοσιακά διαπροσωπικά δίκτυα επικοινωνίας καταρρέουν σε αδιέξοδους επαναλαμβανόμενους μονολόγους μεταξύ υποκειμενικοτήτων και μηχανών.

Ως αποτέλεσμα, ο κατακερματισμός της κοινής αντίληψης της πραγματικότητας μπορεί να οδηγήσει στην κατάρρευση της συνοχής των κοινωνικών φανταστικών σημασιών και των κοινών αξιών. Η συνεχής ροή ανεξέλεγκτων πληροφοριών οδηγεί στη θόλωση της διάκρισης μεταξύ πραγματικότητας και μυθοπλασίας.

Αυτό δημιουργεί έναν ιδεολογικό φαύλο κύκλο παρεξηγήσεων.

Το αποτέλεσμα αυτού θα γίνει αισθητό κοινωνικά ως συρρίκνωση του δημόσιου χώρου και χρόνου και ως εξάπλωση θεωριών συνωμοσίας και άλλων περιθωριακών αφηγήσεων. Αυτό δεν είναι ένα φαντασιακό σενάριο, αλλά ένας πραγματικός κίνδυνος, που τονίζεται από την GRR2026 με έμφαση στις εκλογικές συνέπειες:

«Οι πρόσφατες εκλογές στις Ηνωμένες Πολιτείες, την Ιρλανδία, τις Κάτω Χώρες, το Πακιστάν, την Ιαπωνία, την Ινδία και την Αργεντινή είχαν να αντιμετωπίσουν τέτοιου είδους πλαστά περιεχόμενα στα μέσα κοινωνικής δικτύωσης, τα οποία απεικόνιζαν φανταστικά γεγονότα ή δυσφημούσαν πολιτικούς υποψηφίους, θολώνοντας τη γραμμή μεταξύ πραγματικότητας και μυθοπλασίας. Καθώς η τεχνητή νοημοσύνη χρησιμοποιείται για να κάνει τέτοιο περιεχόμενο πιο εξατομικευμένο και πειστικό, υπάρχει κίνδυνος μεγαλύτερης επίδρασης στις εκλογές. Για παράδειγμα, έρευνα έχει διαπιστώσει ότι το 87% των ανθρώπων στο Ηνωμένο Βασίλειο ανησυχούν για το ενδεχόμενο τα deepfakes να επηρεάσουν τα αποτελέσματα των εκλογών. Ωστόσο, ενώ η ευαισθητοποίηση είναι υψηλή, πολλοί δεν έχουν εμπιστοσύνη στις ικανότητές τους να αναγνωρίσουν πότε το περιεχόμενο είναι παραποιημένο».

Ωστόσο, υπάρχουν ακόμη ευρύτεροι κίνδυνοι που σχετίζονται με τη γνωστική διάβρωση, όπως παραδέχεται η GRR2026:

«Σε ένα ακραίο σενάριο, ο έλεγχος πολλών πτυχών της κοινωνίας θα μπορούσε να παραχωρηθεί στην τεχνητή νοημοσύνη.» – GRR2026

Αυτός είναι ο εφιάλτης της αλγοριθμικής διακυβέρνησης από την άποψη του τεχνοκρατικού απολυταρχισμού, αλλά και το φαντασιακό πρόταγμα δισεκατομμυριούχων όπως ο Elon Musk και ο Peter Thiel, που περιγράφεται σε μια επίσημη πολιτική αναφορά, όπως η GRR. Ωστόσο, δεν είναι το χειρότερο σενάριο που περιγράφει η Έκθεση. Η τρίτη σειρά κινδύνων αφορά την ενσωμάτωση του βιομηχανικού-στρατιωτικού συμπλέγματος στην τεχνοσφαίρα της τεχνητής νοημοσύνης:

«Τρίτον, με την εξάρτηση των στρατών από τα συστήματα τεχνητής νοημοσύνης να συνεχίζει να αυξάνεται, θα αυξηθεί και η πιθανότητα κακής χρήσης ή λαθών, θέτοντας σε άμεσο κίνδυνο ανθρώπινες ζωές.» – GRR2026.

Δεν χρειάζεται να σχολιάσουμε περαιτέρω ή να αναλύσουμε αυτή τη ζοφερή προοπτική για το μέλλον, χωρίς να διακινδυνεύσουμε να βυθιστούμε σε μια τεχνοφοβική δυστοπία. Ωστόσο, η τεχνοφοβία, για άλλη μια φορά, φαίνεται λογική, όταν παρατηρούμε το συμπέρασμα του WEF σχετικά με τους πιθανούς κινδύνους της τεχνητής νοημοσύνης για το 2026:

«Αυτό που διακρίνει την αναστάτωση που προκαλεί η τεχνητή νοημοσύνη από προηγούμενες τεχνολογικές μεταβάσεις είναι η πιθανότητα αλυσιδωτών βλαβών σε διασυνδεδεμένους τομείς. Η μετατόπιση της εργασίας έχει ευρείες επιπτώσεις, σε νοικοκυριά, κοινότητες και πολιτικά συστήματα. Η έλλειψη οικονομικών ευκαιριών ή η ανεργία (που κατατάσσεται στην 14η θέση στην κατάταξη των 10 ετών) μπορεί να οδηγήσει σε εξτρεμισμό. Η δυσπιστία προς τους θεσμούς συνδέεται με την παραπληροφόρηση και την αποπληροφόρηση, ενώ η επιτήρηση ενισχύει τις αυταρχικές αντιδράσεις στην αστάθεια που δημιουργεί η τεχνητή νοημοσύνη. Μόλις δημιουργηθούν, αυτοί οι κύκλοι ενδέχεται να ενισχύονται αμοιβαία». – GRR2026

Αυτό που περιγράφει το WEF είναι αυτό που έχω ονομάσει «ψηφιακή βαρβαρότητα». Είναι αυτό το μόνο πιθανό μέλλον;

Η GRR2026 καταλήγει ενθαρρύνοντας τις κυβερνήσεις των κρατών να συντονιστούν σε αυστηρά μέτρα και κανονισμούς, προειδοποιώντας ότι η τεχνητή νοημοσύνη πρέπει να θεωρείται εξίσου μεγάλη απειλή με τα πυρηνικά όπλα και τα βιοχημικά όπλα:

«Απαιτείται συντονισμός σε θέματα ελάχιστων προδιαγραφών ασφάλειας, διαφάνειας και ηθικής ανάπτυξης, ιδίως για στρατιωτικά, βιομετρικά και μεγάλης κλίμακας συστήματα λήψης αποφάσεων, ο οποίος όμως απαιτεί συνεργασία παρόμοια με εκείνη που απαιτείται για την προστασία από πυρηνικά ή βιολογικά όπλα.» – GRR: 66

Αυτή η ασαφής, κατηγορηματική υπόδειξη κάνει τον αναγνώστη να αναρωτιέται αν οι συγγραφείς διάβασαν τις προηγούμενες σελίδες του εγγράφου, όπου η έλλειψη τέτοιου συντονισμού αναφέρεται ως η αιτία του προβλήματος.

Η φιλοσοφία του δημοκρατικού τεχνοσκεπτικισμού

Αν και η υποδομή του είναι φυσική, ο κυβερνοχώρος είναι ένα πεδίο διαπροσωπικής επικοινωνίας όπου τα ανθρώπινα υποκείμενα είναι οι πραγματικοί κόμβοι της δημιουργίας νοήματος. Το όριο μεταξύ του ψηφιακού και του πραγματικού είναι μια «πορώδης μεμβράνη», που σημαίνει ότι οι ψηφιακές ενέργειες έχουν άμεσες κοινωνικο- ιστορικές συνέπειες. Αναγνωρίζοντας την «οντολογική δυαδικότητα» της ψηφιακής σφαίρας — όπου τα μοντέλα είναι επικοινωνιακές πρακτικές — μπορούμε να γεφυρώσουμε το χάσμα μεταξύ κώδικα και πρακτικής για να οικοδομήσουμε αυτόνομες θεσμούς.

Ο κυρίαρχος λόγος για την τεχνητή νοημοσύνη ταλαντεύεται μεταξύ δύο υπερβολικών τάσεων: της θεσμοθετημένης τεχνοφιλίας και της διάσπαρτης τεχνοφοβίας οι οποίες μοιράζονται το κοινό έδαφος της τεχνολογικής μοιρολατρίας.

Και οι δύο τάσεις συσκοτίζουν το γεγονός ότι η ΤΝ είναι ένας στατιστικός μηχανισμός, που στερείται εσωτερικότητας, προθετικότητας ή αυτονομίας. Ο δημοκρατικός τεχνοσκεπτικισμός προσφέρει μια τρίτη οδό. Απορρίπτει τόσο τις ουτοπικές όσο και τις δυστοπικές φαντασιώσεις και τοποθετεί την τεχνητή νοημοσύνη μέσα στις δομές εξουσίας, τους οικολογικούς περιορισμούς και τις φαντασιακές σημασίες της σύγχρονης κοινωνίας.

Βασισμένος στον ψηφιακό ανθρωπισμό, ο τεχνοσκεπτικισμός επιβεβαιώνει την προτεραιότητα της ανθρώπινης αυτονομίας και την αναγκαιότητα της δημοκρατικής εποπτείας.

Τα ψηφιακά κοινά χρησιμεύουν ως «πρακτικό παράδειγμα» για την επανάκτηση του ψηφιακού. Υλοποιούν αξίες που αντιτίθενται στις καπιταλιστικές νόρμες, όπως η αμοιβαιότητα, η ισότητα, η αλληλεγγύη και η αυτοδιαχείριση. Στα ψηφιακά κοινά, η ανταλλαγή δεν είναι χρήμα, η εργασία δεν εκμεταλλεύεται και η εμπειρία δεν περιορίζεται σε σημεία δεδομένων. Με τον όρο «πρακτικό παράδειγμα» εννοώ, σε αντίθεση με τα θεωρητικά παραδείγματα, ένα μοντέλο που μπορεί να εφαρμοστεί πρακτικά, δημιουργώντας έτσι ένα δίκτυο ανθρώπινων δραστηριοτήτων προς την επίτευξη κοινών στόχων.

Αυτή η γέφυρα μεταξύ κώδικα και πρακτικής είναι δυνατή χάρη στην οντολογική δυαδικότητα της ψηφιακής σφαίρας, όπου τα μοντέλα είναι επικοινωνιακές πρακτικές και όχι απλώς αφαιρέσεις. Ως τέτοιο «πρακτικό παράδειγμα», μπορεί να αναπτυχθεί περαιτέρω σε επικοινωνιακή μορφή κοινωνικών θεσμών κοινωνικής ελευθερίας, δικαιοσύνης, κοινωνικής αυτονομίας, ανακλητότητας, ισότητας, συμμετοχικότητας, αυτοδιοίκησης και κοσμο-τοπικισμού, τόσο στη σφαίρα του κοινού σχεδιασμού και της παραγωγής, όσο και στη σφαίρα του πολιτιστικού διαλόγου και της συν- δημιουργίας. Αυτό συνεπάγεται την από κοινού αναδημιουργία του ελεύθερου δημόσιου χώρου και χρόνου, τόσο στον ψηφιακό όσο και στον πραγματικό κόσμο της ανθρώπινης συνύπαρξης.

Στα ιεραρχικά συστήματα, οι πληροφορίες εξάγονται από κάτω και οι εντολές εκδίδονται από πάνω. Τα ψηφιακά κοινά επιτρέπουν την «αντιστροφή της ροής», όπου οι πολιτικές αποφάσεις παράγονται από την κοινωνική βάση, με βάση πληροφορίες από διαφανείς, δευτεροβάθμιους θεσμούς επεξεργασίας δεδομένων. Αυτό δημιουργεί έναν αυτόνομο ψηφιακό δημόσιο χώρο και χρόνο που υποστηρίζει άμεσα δημοκρατικά οριζόντια δίκτυα.

Τα σύγχρονα δημοκρατικά κοινωνικά κινήματα, που χαρακτηρίζονται από τις διαρκείς συλλογικές διεκδικήσεις με οριζόντιες ισότιμες δικτυώσεις παρέχουν το φυσικό αντίστοιχο των ψηφιακών κοινών. Σε αντίθεση με τα αυταρχικά κινήματα (π.χ. «Τραμπισμός») που χρησιμοποιούν τα ψηφιακά δίκτυα για προπαγάνδα από πάνω προς τα κάτω, τα δημοκρατικά κινήματα δίνουν έμφαση στις οριζόντιές δικτυώσεις, την άμεση δημοκρατία και την άρνηση της ιεραρχικής ηγεσίας.

Μπορούμε να φανταστούμε τον τεχνοσκεπτικισμό σαν ένα θεωρητικό τηλεσκόπιο – μας βοηθά να ανακαλύψουμε πιθανές διαδρομές του προτάγματος της αυτονομίας στον ορίζοντα των μελλοντικών προσδοκιών. Ο ψηφιακός ανθρωπισμός είναι σαν μια πολιτική πυξίδα – μας βοηθά να πλοηγηθούμε προς ένα κοινό δημοκρατικό μέλλον. Ο ψηφιακός ανθρωπισμός βασίζεται στις ανησυχίες που εγείρει ο τεχνοσκεπτικισμός, προσφέροντας λύσεις και αρχές σχεδιασμού. Ενσωματώνει τις αρχές της άμεσης δημοκρατίας, των κοινών και της κοινωνικής οικολογίας στην τεχνολογική κριτική.

Η χρονικότητα και η κοινωνικότητα είναι οι βασικές προϋποθέσεις για αυτές τις πράξεις επανάκτησης του ψηφιακού. Σε αυτό το πλαίσιο, τα άτομα που επιτρέπουν στον προσωπικό τους χρόνο να αποικιστεί, να απορροφηθεί και να ενσωματωθεί στους κυρίαρχους ρυθμούς των κοινωνικών δικτύων, της τηλεπαρουσίας και του ψηφιακού μάρκετινγκ, συμβάλλουν ενεργά στην επέκταση των δικτύων καπιταλιστικού μάρκετινγκ. Όπως παρατήρησα προηγουμένως, στον ψηφιακό κόσμο, τα μοντέλα είναι πρακτικές και οι καπιταλιστικοί όροι της ψηφιακής αναπαράστασης είναι όροι ατομικής εμπορευματοποίησης. Ως εκ τούτου, δημιουργούν καταναλωτικές κοινότητες, οι οποίες λειτουργούν ως επιταχυντές της κυκλικής, επαναλαμβανόμενης χρονικότητας της εκμετάλλευσης των δεδομένων και της δημόσιας απόσπασης της προσοχής.

Αυτός ο κύκλος τροφοδοτεί τον πολλαπλασιασμό των κοινωνικών κρίσεων μέσω της εξάπλωσης του ατομικιστικού καταναλωτισμού, της πολιτικής απάθειας ή του φανατισμού, της διάδοσης διαφημιστικών στρατηγικών και της πραγμοποίησης της προσωπικής εμπειρίας. Ο χρόνος και η κοινότητα με τη μορφή της προσωπικής δέσμευσης και των συλλογικών εμπειριών είναι τα νέα εμπορεύματα, κατακερματισμένα υπό την πλασματική αρχή της ψηφιακής ατομικότητας.

Αντίθετα, η πρακτική της ψηφιακής επανάκτησης συνίσταται στη δημιουργία μιας ελεύθερης κοινής χρονικότητας μέσω των εργαλείων που παρέχουν τα ψηφιακά κοινά σε ανοιχτές δημοκρατικές δικτυώσεις.

Η τρέχουσα κρίση της τεχνητής νοημοσύνης και του καπιταλισμού της επιτήρησης παρουσιάζει μια επιλογή μεταξύ δύο προοπτικών: η μία είναι η επέκταση της καθεστωτικής ψηφιακής κυριαρχίας επί της κοινωνίας και το άλλο η συλλογική δημοκρατική επανακτήση του ψηφιακού. Ο δημοκρατικός τεχνοσκεπτικισμός στοχεύει σε ένα μετακαπιταλιστικό, οικολογικό και ανθρωπιστικό μέλλον, όπου η τεχνολογία χρησιμεύει για την ενίσχυση, και όχι την καταστολή, της δημοκρατικής αυτοκυβέρνησης.

Βιβλιογραφία

Benasayag, M.. The Tyranny of Algorithms. The impact of the digital world and its algorithms on human

beings and society Europa Compass, (2021)

Benedikt, M.. Cyberspace: First Steps The MIT Press, Boston (1991)

Simondon, G. Incorporations Zone Books, New York (1992)

Καστοριάδης, Κ.. Η Φαντασιακή Θέσμιση της Κοινωνίας, εκδ. Ράππα (1978)

Phang, J. et al. Investigating Affective Use and Emotional Well-being on ChatGPT,

https://cdn.openai.com/papers/15987609-5f71-433c-9972-e91131f399a1/openai-affective-use

study.pdf. retrieved November 28 2025, 21.05

Polanyi, K.. The Great Transformation: The Political and Economic Origins of Our Time Farrar & Rinehart,

New York (1944)

Wylie, B. : Zuboff’s cycle of dispossession (2020) Retrieved on 4/4/2024 from:

https://biancawylie.medium.com/zuboffs-cycle-ofdispossession/

Σχισμένος, A. Τεχνολογία και Βαρβαρότητα: Κριτική της Τεχνητής Νοημοσύνης, Athens School (2024)

Winner Bull. Sci. Tech. Soc . , Vol. 4, pp. Printed in the USA. 2070-4676/84 Pergamon Press, Ltd.582-596,

1984

Zuboff, Sh.. The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of

Power PublicAffairs, New York (2019)

World Economic Forum: Global Risks Report 2026