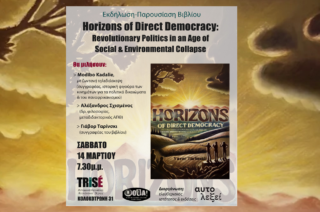

Την Παρασκευή 2 Φεβρουαρίου, οι χώρες της Ευρωπαϊκής Ένωσης προχώρησαν στην πρώτη παγκόσμια συμφωνία ρύθμισης της Τεχνητής Νοημοσύνης (ΑΙ), με τα ΑΙ συστήματα να χωρίζονται σε 4 κατηγορίες. Κείμενο: Αλέξανδρος Σχισμένος

Η δημoσιοποίηση του ChatGPT στα τέλη Νοεμβρίου 2022 έφερε τη συζήτηση για τα λογισμικά Τεχνητής Νοημοσύνης [ΑΙ-ΤΝ] στο επίκεντρο της παγκόσμιας προσοχής. Λίγους μήνες αργότερα ο Noam Chomsky, δήλωσε στους New York Times, στις 8 Μαρτίου 2023:

“Το ανθρώπινο μυαλό δεν είναι, όπως το ChatGPT και τα παρόμοιά του, μια λαίμαργη στατιστική μηχανή για την αναγνώριση δομών, που καταπίνει εκατοντάδες terabytes δεδομένων και αρπάζει την πιο εύλογη απάντηση σε μια συνομιλία ή την πιο πιθανή σε μια επιστημονική ερώτηση. Το αντίστροφο… το ανθρώπινο μυαλό είναι ένα εκπληκτικά αποτελεσματικό και κομψό σύστημα που λειτουργεί με περιορισμένο αριθμό πληροφοριών. Δεν προσπαθεί να τραυματίσει τις πρώτες συσχετίσεις από τα δεδομένα, αλλά προσπαθεί να δημιουργήσει εξηγήσεις. [… ]

Ας σταματήσουμε να το αποκαλούμε “Τεχνητή Νοημοσύνη” και να το ονομάσουμε αυτό που είναι: “λογισμικό λογοκλοπής.” Δεν δημιουργεί τίποτα, αντιγράφει υπάρχοντα έργα από υπάρχοντες καλλιτέχνες τροποποιώντας το αρκετά για να ξεφύγει από τους νόμους περί πνευματικών δικαιωμάτων. Είναι η μεγαλύτερη κλοπή περιουσίας από τότε που οι ιθαγενείς της Αμερικής αφαιμάχθησαν από Ευρωπαίους εποίκους”.

Η ανησυχία του Chomsky δεν είναι πως η ΤΝ θα υποκαταστήσει με κάποιον, παράδοξο τρόπο, την ανθρώπινη νοημοσύνη, αλλά πως θα αποτελέσει κατεξοχήν εργαλείο λογοκλοπής.

Η παρατήρηση του Chomsky είναι ιδιαίτερα επίκαιρη στη χώρα μας τις τελευταίες ημέρες, όταν η κυβέρνηση Μητσοτάκη εξαναγκάζει με απειλές και εισαγγελική έρευνα τις Πρυτανικές Αρχές να διεξάγουν τις φοιτητικές εξετάσεις των κατειλημμένων σχολών εξ αποστάσεως. Η καθ’ ύλην αρμόδια για το επιστημονικό πεδίο Σχολή Πληροφορικής του ΑΠΘ έβγαλε την 1η Φεβρουαρίου 2024 την εξής ανακοίνωση:

“Τονίζουμε πως δεν υπάρχει κανείς γνωστός τρόπος να εγγυηθεί ένα Ανώτατο Εκπαιδευτικό Ίδρυμα το αδιάβλητο των εξετάσεων από απόσταση.

Στα ανωτέρω συμπεράσματα οδηγούμαστε λόγω:

(α) της αρνητικής εμπειρίας των εξ αποστάσεως εξετάσεων στην περίοδο του COVID-19

(β) της ύπαρξης, από έτους περίπου, ισχυρών εργαλείων τεχνητής νοημοσύνης που μπορούν αν υποκαταστήσουν τον/την εξεταζόμενο/η με καλά αποτελέσματα

(γ) της μη διαθεσιμότητας από τα ΑΕΙ εργαλείων ελέγχου του περιβάλλοντος του/της εξεταζόμενου/ης.”

Το δεύτερο σημείο (β) της ανακοίνωσης επιβεβαιώνει την ανησυχία του Chomsky.

Ωστόσο, ο καθηγητής του MIT δεν ασχολείται με τις ελληνικές εξετάσεις. Η λογοκλοπή στην οποία αναφέρεται είναι η δημιουργία δευτερογενών έργων λόγου, εικόνας και τέχνης από παραλλαγές διαφορετικών πρωτοτύπων. Η ανησυχία αυτή ήταν μία από τις αιτίες της τετράμηνης απεργίας των σεναριογράφων στο Χόλιγουντ το περασμένο καλοκαίρι.

Πώς αντιμετωπίζεται αυτό;

Αν δώσω εντολή σε ένα πρόγραμμα Τεχνητής Νοημοσύνης να γράψει ένα ποίημα, θα το κάνει. Άλλοι θα πουν ότι δεν είναι ποίημα, αφού το έγραψε η μηχανή, άρα του λείπει το ποιητικό περιεχόμενο, άλλοι θα πουν ότι είναι, αφού θα έχει τη μορφή ποιητικού γραπτού λόγου. Σε ποιον θα ανήκουν όμως τα πνευματικά δικαιώματα του ποιήματος; Ή της εικόνας ή της μελωδίας που παράγει ένα Generative AI; –

“Εάν τα παραδοσιακά στοιχεία της πνευματικής ιδιοκτησίας ενός έργου έχουν παραχθεί από μηχανή, το έργο στερείται ανθρώπινης πνευματικής ιδιοκτησίας και το Γραφείο δεν θα το καταχωρίσει.” λέει το Γραφείο Πνευματικών Δικαιωμάτων των ΗΠΑ.

Θα μπορούσαμε να πούμε δηλαδή ότι είναι εξαρχής κοινό κτήμα. Είναι όμως; Σαφώς όχι, αφού αποτελεί ιδιωτικό και εμπορεύσιμο προϊόν. Το θεσμικό πλαίσιο των ΗΠΑ δεν είναι επαρκώς επικαιροποιημένο για να αντιμετωπίσει τέτοιες μορφές λογοκλοπής.

Η απουσία επαρκούς θεσμικού πλαισίου καθιστά ιστορική τη συμφωνία στην οποία κατέληξαν στις 2/2/2024 τα 27 μέλη-κράτη της Ε.Ε. για το νομικό έλεγχο της Τεχνητής Νοημοσύνης και την ίδρυση Ευρωπαϊκού Γραφείου Τεχνητής Νοημοσύνης – το πρώτο κείμενο θεσμικής ρύθμισης της AI παγκοσμίως. Το κείμενο της συμφωνίας ταξινομεί τις εφαρμογές AI σε 4 κατηγορίες [απαγορευμένες / υψηλού ρίσκου / μετρίου ρίσκου / ελαχίστου ρίσκου] και εφαρμόζει συγκεκριμένους ελέγχους και περιορισμούς ανά κατηγορία. Ξεχωριστό ενδιαφέρον έχει ποιες εφαρμογές απαγορεύονται διά παντός στην Ε.Ε.

Με μια ματιά στη σύνοψη του νόμου βλέπουμε ότι οι απαγορεύσεις αφορούν τη διασπορά ψευδών ειδήσεων, τη διασπορά ρατσιστικών στερεοτύπων, την παρακολούθηση και καταγραφή, την προληπτική καταστολή, την ταυτοποίηση – εκτός βέβαια όταν τα εργαλεία χρησιμοποιούνται από τις νόμιμες εξαιρέσεις των κρατικών μηχανισμών:

«ΑΠΑΓΟΡΕΥΟΝΤΑΙ

1. Συστήματα τεχνητής νοημοσύνης που:

– κάνουν χρήση υποσυνείδητων, χειριστικών ή παραπλανητικών τεχνικών για τη στρέβλωση της συμπεριφοράς και την εξασθένιση της λήψης τεκμηριωμένων αποφάσεων, προκαλώντας σημαντική βλάβη.

– προχωρούν σε εκμετάλλευση τρωτών σημείων που σχετίζονται με την ηλικία, την αναπηρία ή τις κοινωνικοοικονομικές συνθήκες για τη στρέβλωση της συμπεριφοράς, προκαλώντας σημαντική βλάβη.

2. Συστήματα βιομετρικής κατηγοριοποίησης που συμπεραίνουν ευαίσθητα χαρακτηριστικά (φυλή, πολιτικά φρονήματα, συμμετοχή σε συνδικαλιστική οργάνωση, θρησκευτικές ή φιλοσοφικές πεποιθήσεις, σεξουαλική ζωή ή σεξουαλικό προσανατολισμό), εκτός από την επισήμανση ή το φιλτράρισμα νομίμως αποκτηθέντων συνόλων βιομετρικών δεδομένων ή όταν η επιβολή του νόμου κατηγοριοποιεί βιομετρικά δεδομένα.

3. Συστήματα κοινωνικής βαθμολόγησης, δηλαδή αξιολόγηση ή ταξινόμηση ατόμων ή ομάδων με βάση την κοινωνική συμπεριφορά ή τα προσωπικά χαρακτηριστικά, προκαλώντας δυσμενή ή δυσμενή μεταχείριση των ατόμων αυτών.

4. Συστήματα αξιολόγησης του κινδύνου διάπραξης εγκληματικών πράξεων από ένα άτομο αποκλειστικά βάσει προφίλ ή χαρακτηριστικών της προσωπικότητας, εκτός εάν χρησιμοποιείται για την ενίσχυση των ανθρώπινων αξιολογήσεων που βασίζονται σε αντικειμενικά, επαληθεύσιμα γεγονότα που συνδέονται άμεσα με εγκληματική δραστηριότητα.

5. Απαγορεύεται η κατάρτιση βάσεων δεδομένων αναγνώρισης προσώπου με μη στοχευμένη απόσπαση εικόνων προσώπου από το διαδίκτυο ή από υλικό από κάμερες κλειστού κυκλώματος παρακολούθησης.

6. Απαγορεύεται η συναγωγή συμπερασμάτων για συναισθήματα σε χώρους εργασίας ή εκπαιδευτικά ιδρύματα, εκτός αν συντρέχουν ιατρικοί λόγοι ή λόγοι ασφαλείας.

7. Απαγορεύεται η σε πραγματικό χρόνο απομακρυσμένη βιομετρική ταυτοποίηση (RBI) σε δημόσια προσβάσιμους χώρους για την επιβολή του νόμου, εκτός από περιπτώσεις τρομοκρατίας».

Αν δούμε το κείμενο, θα αντιληφθούμε ότι ο κίνδυνος της λογοκλοπής είναι υπαρκτός, αλλά επίσης είναι ο μικρότερος κίνδυνος από όσους περιλαμβάνουν οι δυνατότητες της ΤΝ.

Η παρακολούθηση, η καταγραφή, η προληπτική καταστολή, η χειραγώγηση της κοινής γνώμης είναι μέσα στο φάσμα αυτών των δυνατοτήτων. Κάποιες από αυτές χρησιμοποιούνται από το καθεστώς της Κίνας για την παρακολούθηση, καταγραφή και αξιολόγηση των κατοίκων της αχανούς χώρας.

Κάποιες χρησιμοποιήθηκαν από ανώνυμους ιδιώτες, όπως η χειραγώγηση της κοινής γνώμης μέσω της παραγωγής ακριβών αντιγράφων φωνής και εικόνας – deep fakes. Η πιο πρόσφατη τέτοια προσπάθεια στις ΗΠΑ αφορούσε ένα πλαστό ηχογραφημένο μήνυμα του Μπάιντεν που καλούσε τους κατοίκους μιας πολιτείας να απέχουν.

Τα κράτη της Ε.Ε. έθεσαν πρώτα παγκοσμίως ένα θεσμικό ρυθμιστικό πλαίσιο που προστατεύει τον πληθυσμό από τέτοιες δυνατότητες – εκτός αν πρόκειται να χρησιμοποιηθούν από τα ίδια τα κράτη, όπως προβλέπει ρητά το πλαίσιο.

Είναι άραγε απαισιόδοξη η εκτίμηση ότι θα χρησιμοποιηθούν;